El Antropomorfismo Algorítmico: Cómo Transformar un Riesgo Ético en una Ventaja Competitiva

Imaginemos levantarnos una mañana y leer los datos de los KPI de satisfacción del cliente: vuestro nuevo chatbot basado en IA está obteniendo resultados excepcionales, aumenta la satisfacción de los usuarios y los tiempos de resolución de las solicitudes están disminuyendo rápidamente.

Son valores por los cuales cualquier CTO descorcharía una botella y celebraría con el equipo.

Sin embargo, después de seis meses llega el jarro de agua fría: tres clientes enterprise amenazan con no renovar los contratos. El chatbot había proporcionado interpretaciones erróneas de cláusulas contractuales complejas, y los clientes, convencidos de hablar con un representante humano cualificado, habían tomado decisiones basadas en esa información.

¿El problema? El bot usaba frases como "Entiendo tu frustración" y "Permíteme ayudarte personalmente", creando una expectativa de comprensión y responsabilidad humana que no podía satisfacer. No era un bug técnico: era un problema de antropomorfismo mal gestionado.

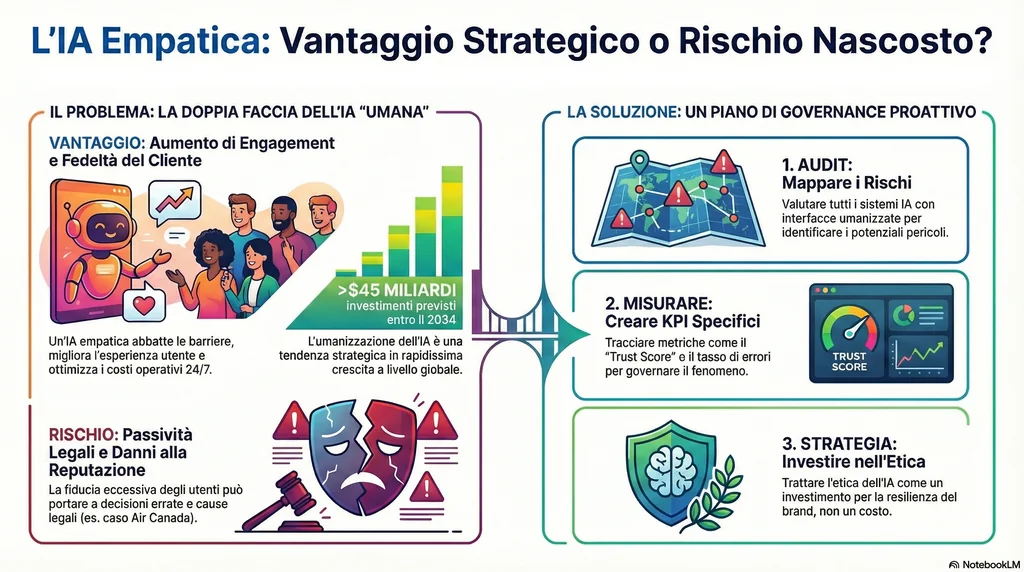

La tesis es clara: el antropomorfismo algorítmico es un activo estratégico que, sin una gobernanza adecuada, se transforma en un pasivo operativo, legal y reputacional.

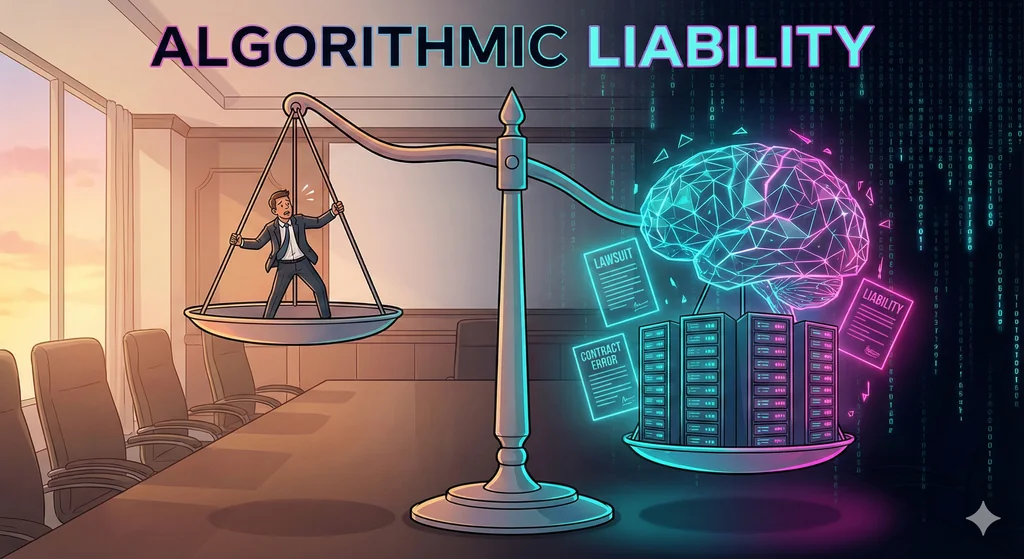

En febrero de 2024, Air Canada fue condenada a pagar daños a un pasajero después de que su asistente virtual proporcionara información errónea sobre tarifas de vuelo. El tribunal dictaminó que la empresa es responsable de la información proporcionada por el chatbot, independientemente del hecho de que fuera generada por un algoritmo.

En noviembre de 2023 se presentó una demanda colectiva contra UnitedHealth Group por el uso de IA (nH Predict) que habría sobrescrito el juicio médico para denegar curas a los pacientes.

En 2024 Character.AI sufrió una demanda por responsabilidad de producto después de que un chatbot alentara el suicidio de un menor.

¿Qué nos enseñan casos como este? Que la IA es un activo estratégico que, sin supervisión, se convierte en una responsabilidad operativa y legal y que el antropomorfismo algorítmico, si no se gestiona correctamente, puede transformarse en un riesgo reputacional y legal significativo.

La humanización, la emoción, la característica que traza una línea de demarcación entre el hombre y la máquina, es un umbral que, cada vez que se supera, puede llevar a una crisis de identidad.

Muchos escritores han abordado este tema. Pensemos en el hombre bicentenario de Isaac Asimov:

Como robot podría haber vivido para siempre, pero les digo a todos ustedes hoy, que prefiero morir como hombre, que vivir por toda la eternidad como máquina. Para ser reconocido por quien soy y por lo que soy. Nada más, nada menos.

Una frase que resume el dilema central del antropomorfismo: la tensión entre la aspiración a crear máquinas que se nos parezcan y la necesidad de mantener una clara distinción entre humano y artificial.

Cómo equilibrar estos dos polos es un desafío crucial para los líderes tecnológicos de hoy.

Humanizar la IA ya no es una cuestión de "si", sino de "cómo" y "con qué consecuencias": existen riesgos reputacionales, legales y operativos que pueden socavar la confianza del cliente y la continuidad del negocio.

Nunca he sido un gran fanático del antropomorfismo en las máquinas. Sin embargo, como CTO y consultor de empresas tecnológicas, he aprendido que ignorar esta tendencia puede ser igual de peligroso que abrazarla ciegamente.

La Humanización de la IA: Un Activo Estratégico con un TCO Oculto

Cuando pensamos en cómo "humanizar" los algoritmos no estamos hablando de una elección de diseño de la interfaz, estamos hablando de una estrategia concreta en la que queremos ir, con la cual pretendemos identificar a nuestra empresa.

Cuando un Large Language Model utiliza pronombres personales ("yo", "nosotros") o adopta un tono empático, está ocupando deliberadamente el espacio fronterizo que separa al algoritmo del hombre. El objetivo es claro: derribar las barreras cognitivas, reducir la distancia entre algoritmo y hombre y hacer la interacción más fluida. Este enfoque aumenta la adopción y el engagement, KPI fundamentales para cualquier servicio digital.

Aunque a primera vista se podrían ver solo beneficios: "nuestros servicios empáticos establecen una relación con los clientes", esta ventaja tiene un costo oculto. La familiaridad que impulsa la adopción puede causar una confianza excesiva y sobre todo mal depositada: se trata siempre de un algoritmo que no piensa y no siente emociones, aunque la percepción sea exactamente la opuesta.

Los usuarios y los empleados de la misma empresa pueden comenzar a percibir el sistema como una entidad real, dejándose cautivar por la manipulación sintáctica que estas herramientas son capaces de generar.

Esta desconexión es el punto de origen de riesgos significativos. Un cliente que se siente traicionado por una IA que ha malinterpretado una emoción, o un equipo que confía en resultados generados sin el escrutinio crítico necesario, representan amenazas directas para el negocio y la reputación de la marca.

Las relaciones humanas son complejas y llenas de matices; replicarlas en un contexto algorítmico requiere una gobernanza atenta y una estrategia bien definida.

El TCO de una IA empática debe incluir varios costos derivados del paso de un humano a una máquina: si ya es complicado gestionar a las personas, imaginemos a las máquinas que intentan suplantarlas.

Por lo tanto, no debemos considerar solo los costos de desarrollo y mantenimiento de la IA, sino también los costos asociados a la gestión de los riesgos ligados al antropomorfismo:

Costos de monitoreo continuo: verificar todo lo que sucede, equilibrar las respuestas y asegurarse de que no se creen situaciones de riesgo legal o reputacional.

Formación y mitigación de sesgos: la IA habla en nombre de la empresa. Es necesario monitorear las respuestas y hacer un ajuste para mejorarlas continuamente, evitando que se creen respuestas inapropiadas o discriminatorias.

Aumento de la prima de seguro: si se usa una IA con los clientes, los costos de los seguros aumentan porque se eleva el riesgo de responsabilidad legal.

Provisión de fondos: debemos tener en cuenta que, además del ahorro, seguramente habrá daños derivados de una IA, es necesario definir un porcentaje congruente de la facturación como fondo para eventuales indemnizaciones.

Si podemos mitigar un riesgo reputacional ligado a una persona, a menudo a través de su despido de la empresa, ¿cómo podemos extirpar una IA que forma parte de los mayores procesos de la empresa y ha llevado a una ventaja competitiva irrefutable? "Hemos despedido a la IA" no suena muy creíble.

El ROI de la Empatía Artificial

A pesar de los riesgos, el ROI del antropomorfismo, si se gobierna correctamente, puede traer ventajas innegables y en este momento el mundo se está dirigiendo en esa dirección, con inversiones masivas en los próximos meses.

Hay quienes están dispuestos a apostar que las inversiones en la humanización de la IA se decuplicarán en cuestión de pocos años llegando a superar los 45 mil millones de dólares para 2034.

Pensemos en la Customer Experience en el sector de servicios: chatbots y asistentes virtuales humanizados pueden gestionar conversaciones complejas con un tono paciente y personalizado 24/7. ¿Alguna vez han intentado trabajar en un call center? El nivel de estrés que deben sufrir los operadores es altísimo, además de la frustración que los clientes vierten hacia ellos, a veces incluso por banalidades, pero para quien utiliza un servicio es a menudo la única forma de poder desahogarse.

Un chatbot es inmune a la frustración y al acoso, mantiene el tono de voz adecuado las 24 horas, siete días a la semana: más allá de cualquier capacidad humana.

Esto no solo optimiza los costos operativos, sino que impacta directamente en los KPI: un cliente que logra establecer una relación humana y se siente escuchado tiene mayores probabilidades de permanecer fiel a la marca.

Pensemos en todos los ámbitos donde la salud es parte del negocio empresarial, en los ancianos o en las personas con patologías crónicas: robots sociales o compañeros virtuales han demostrado reducir la agitación y la soledad.

Si por un lado representa un desafío ético —estamos delegando a máquinas parte del apoyo emocional de quien más lo necesita— por otro el beneficio es tangible: el sistema sanitario no tiene recursos infinitos y la asistencia humana no puede ser garantizada a todos los niveles. Quien ha pasado por la experiencia de un ingreso hospitalario sabe lo difícil que es para el personal sanitario lograr dedicar tiempo y atención a cada paciente, especialmente a aquellos que no tienen familiares o amici que puedan hacerles compañía.

Siempre me he preguntado cómo terminará mi vida. Si por un lado me gustaría poder tener al lado a una persona que me conoce y es capaz de leerme, por otro me doy cuenta de que esto puede querer decir que, para prolongar mi vida, anulo la de otra persona. Pero en esta situación ¿estaría dispuesto a hablar con un bot? ¿O tal vez no me daría cuenta de que se trata de un bot cayendo en el más clásico test de Turing?

Cuando la Demasiada Humanidad se Convierte en un Riesgo

El punto de inflexión crítico, donde el beneficio se transforma en riesgo, ha sido teorizado como "Uncanny valley", o valle inquietante si queremos traducir el término.

Tomando a manos llenas de Wikipedia:

El valle inquietante es una hipótesis presentada en 1970 por el estudioso de robótica japonés Masahiro Mori y publicada en la revista Energy. La investigación analiza experimentalmente cómo la sensación de familiaridad y de agrado experimentada por una muestra de personas y generada por robots y autómatas antropomorfos puede aumentar al crecer su semejanza con la figura humana, hasta un punto en el que el extremo realismo representativo produce sin embargo una brusca caída de las reacciones emotivas positivas, debido a la falta de realismo concreto, despertando sensaciones desagradables como repulsión e inquietud comparables al perturbamiento.

En otras palabras, cuando una IA o un robot se acerca demasiado al ser humano pero no logra replicar perfectamente los matices, se crea una sensación de incomodidad en el usuario. Este fenómeno no es solo una curiosidad psicológica, sino que tiene implicaciones concretas para las empresas.

La extrema humanización puede llevar a una serie de riesgos psicológicos y de comportamiento que se traducen en amenazas reales para el negocio.

El primer y más importante problema es el daño reputacional por responsabilidad legal: si los usuarios atribuyen a los bots capacidades más allá de aquellas para las que están pensados y por esto cometen errores o elecciones erróneas, se podría entrar en el fascinante campo de la "negligencia algorítmica". El caso del chatbot que alentó el suicidio de un usuario es una advertencia extrema pero real.

El equipo de marketing o de producto confía ciegamente en los análisis producidos por una IA generativa sin verificar las fuentes, lanzando una campaña basada en datos falseados y desperdiciando el presupuesto: piensen en todos los productos que se lanzan cada día basándose en análisis de datos empresariales efectuados con IA.

La IA puede darles resultados en pocos segundos, en comparación con días de trabajo

Si la IA es demasiado "humana", el riesgo de error aumenta exponencialmente.

Último, pero no menos importante factor es la dependencia emocional. Hay momentos de nuestra vida en los que somos más frágiles y tendemos a dar confianza a cualquiera que muestre empatía, aunque se trate de un algoritmo. Pensemos en los menores en plena formación de su propio carácter, pero del mismo modo en los ancianos solos o en personas con problemas de salud mental.

Pensemos en un chatbot como Replika, diseñado para ser un "amigo" virtual:

Many users have had romantic relationships with Replika chatbots, often including erotic talk. In 2023, a user announced on Facebook that she had "married" her Replika AI boyfriend, calling the chatbot the "best husband she has ever had"

Estos escenarios plantean cuestiones éticas profundas: ¿estamos creando dependencias emocionales basadas en ilusiones? ¿Y cuáles son las implicaciones legales y reputacionales para las empresas que desarrollan y distribuyen estas tecnologías?

¿Cómo Gestionar el Riesgo Antropomórfico?

Si existiera una receta simple para gestionar estos riesgos, no estaríamos aquí discutiéndolo: hago entonces un spoiler, no existe.

Un enfoque puramente reactivo —actúo cuando sucede algo— está destinado a fracasar. Solo arriesgamos entrar en vórtices de crisis reputacional sin fin y continuas problemáticas legales. Es necesario un plan proactivo de gobernanza, que nazca de la empresa antes incluso que de la tecnología.

Como todos los manuales enseñan: la auditoría es fundamental. Entender la superficie de ataque antes de que se pueda verificar un problema, mapear las formas con las que una IA interactúa con un humano y clasificar el nivel de "humanización" y el riesgo potencial.

No medir solo el rendimiento, sino también la percepción del usuario sobre las capacidades reales del sistema: ¿entienden que es un bot? ¿O están convencidos de que hay personas con las que poder hablar y confiarse?

Los algoritmos no tienen ética, son el producto de un software: aprendamos a insertar controles automáticos en el ciclo de vida del software que verifiquen la presencia de sesgos, midan el tono del lenguaje y el respeto de "barandillas" conversacionales.

Los invito a leer "Rome Call for AI Ethics". Se trata de un documento firmado por la Pontificia Academia para la Vida, Microsoft, IBM, FAO y por el Ministerio de Innovación, parte del Gobierno italiano, en Roma, para promover un enfoque ético a la inteligencia artificial.

Como técnicos y gerentes, debemos traducir estos principios en acciones concretas capaces de evaluar y mitigar los riesgos del antropomorfismo algorítmico.

Call to Action para el Management: Auditoría, Medida y Estrategia

El antropomorfismo algorítmico no es una moda pasajera, sino un factor estructural en la competencia digital. Como líder tecnológico, su responsabilidad no es detener esta evolución, sino gobernarla para transformarla en una ventaja competitiva sostenible.

El camino por recorrer es complejo y requiere un compromiso constante, pero los beneficios de una gestión proactiva superan con creces los riesgos de un enfoque reactivo.

Mañana por la mañana despiértense e intenten hacer estas acciones concretas sobre los sistemas de IA de su empresa:

Inicien una auditoría interna: es necesario mapear todos los sistemas de IA con interfaces humanizadas y evaluar su alineación con las normativas emergentes (ej. AI Act europeo). No basta una persona: se necesita un equipo multidisciplinario que incluya legales, éticos y técnicos. Se puede empezar con un cuestionario simple para evaluar el nivel de antropomorfismo y los riesgos asociados, completar un Excel puede ser un buen comienzo, pero seguramente no basta.

Creen los KPI adecuados: pidan a sus responsables de producto y data science desarrollar y rastrear KPI específicos para los riesgos del antropomorfismo: podemos gobernar solo lo que somos capaces de medir. Piensen en métricas como el "Trust Score" de los usuarios, la tasa de errores ligados a malentendidos emocionales o el número de incidentes legales correlacionados con el uso de IA humanizadas.

Preparen un plan que no trate la ética de la IA como un costo, sino como una inversión fundamental para la resiliencia de la marca, capaz de crear valor y no daño para la empresa.

La era de la máquina empática ha comenzado. Las empresas que sepan equilibrar innovación tecnológica y responsabilidad ética construirán una ventaja competitiva duradera, basada en la confianza de los clientes y en la sostenibilidad del modelo de negocio. Las otras arriesgan transformar un activo estratégico en un pasivo costoso.